Google confirme publiquement ce qu’il avait annoncé voilà 4 mois lors du search I/O , l’arrivée dans ses datacenters d’une couche supplémentaire d’intelligence artificielle pour son moteur de recherche.

Qu’est ce que MUM ?

Rappelons que MUM signifie Multitask Unified Model, un algo plus puissant que les modèles BERT. MUM est “multimodal”, ce qui signifie qu’il peut comprendre des informations provenant non seulement d’un texte, mais aussi d’une image, d’une vidéo ou d’un son. Google indique une puissance supérieur à 1000 fois BERT. Toujours plus !! Activez les sous titres en Français pour la vidéo Mum ci dessous , sinon, c’est pas trop compliqué à comprendre 🙂

10 améliorations apportées par Google Mum

- Des réponses à des questions plus complexes et plus longues.

- Une meilleure compréhension de la langue pour fournir des réponses utiles.

- Des réponses plus complètes à des requêtes plus complexes.

- Des réponses à des requêtes plus larges avec moins de recherches.

- MUM peut comprendre plus profondément l’intention de recherche d’un mot-clé.

- MUM peut révéler des informations par une exploration plus approfondie.

- MUM est capable de comprendre des informations dans plusieurs langues.

- Il peut également comprendre des formats universels.

- Il accorde une attention particulière aux modèles sémantiques qui indiquent des biais d’apprentissage automatique.

- Il est construit sur une architecture transformer (voir ci dessous)

Principales caractéristiques de MUM

Afin d’avoir une pertinence sans égal, MUM de google est développé sur trois dimensions :

- Multilingue : analyse des résultats dans 75 langues

Traitement des langues

Google MUM veut mets fin aux barrières d’une langue pour proposer des résultats exhaustifs, peut importe le type de demande initiale. Partout dans le monde, la nouvelle technologie utilisée va tâcher de regrouper l’ensemble des résultats et quelque soit la langue. Les résultats seront en francais; anglais ou en japonais, voire dans d’autres langues mais peu importe. L’architecture de réseau neuronal développée par le moteur de recherche en 2017, Transformer efface les limites linguistiques. Google MUM va chercher les connaissances là ou elles se trouvent sans barrière géographique. Les traductions se feront en instantannée !

- Multimodal : Google va chercher tous les formats , que ce soit du texte, images et sous peu, cela les vidéos et audios. Comprendre ce qui se trame derrière une chaine de caractères, des pixels de couleur, des ondes sonnores , des flux d’images, c’est ce que promet notre cher Google !

- Multitâche : traitement de plusieurs tâches en simultané avec analyse des différents contenus, des résultats en plusieures langues et fournir une réponse. Cela va donc à l’analyse des langues, la recherche de formats (audio, vidéo, image, texte) , le regroupement des termes et leur traduction.

Mum comment cela marche, mode d’emploi ?

Le cas présenté par google ci dessous à partir d’une recherche du genre : j’ai grimpé le col d’aspin , maintenant comment puis je me préparer pour le Mont Blanc ? Google d’abord tâche de comprendre la requête et les liaisons sémantiques, puis va chercher dans son index des sources de diverses formats.

A partir d’une demande complexe Mum va chercher l’information

Sur le moteur de recherche

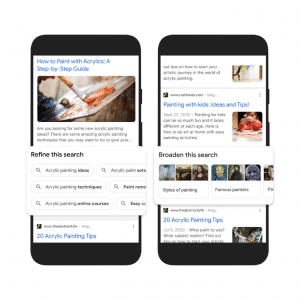

Tout d’abord, MUM va se montrer dans les pages de résultats de recherche afin de vous présenter de nouvelles alternatives après l’affichage des résultats.

Le libellé “choses à savoir” (things to know) va affiner la requête grâce à des suggestions. Pour la recherche “guide sea google ads”, Google va présenter, entre autres, un guide pour les débutants, des liens vers d’autres types de guides et un mode d’emploi pour démarrer une campagne. Par ailleurs, un nouveau module “affiner la recherche” pourra aider à affiner une recherche.

Affinage de la recherche avec Mum

Sur l’application Google Lens

MUM va apparaître aussi sur Lens, le service de recherche via des images de Google. Bientôt, vous pourrez combiner une requête visuelle et une question en langage naturel.

Par exemple, vous pouvez prendre une photo d’une paire de chaussure comme l’indique google dans sa présentation, et ajouter une question afin d’aller plus loin dans la capacité de cette même paire pour aller faire une randonnée spécifique ! Il est prévu que Lens soit intégré dans le navigateur Chrome comme recherche visuelle intégrée. Déjà disponible dans les versions Beta et Canary de Chrome 94, la fonction est manuelle et accessible dans le menu “Fonctions expérimentales” . Pour tester, rendez vous sur la page chrome : // flags / # enablelensregionsearch dans Chrome et activer le flag puis redémarrer le browser.

Google Lens avec Mum

Pour conclure sur Mum

D’une point de vue Seo, pas de quoi s’allarmer sans doute ! Les formats sources restent les mêmes à ce jour, donc la précision dans leur formatage (choix des mots, métadonnées, liens ) sera de rigueur d’autant plus.

Sinon, Pandu Nayak précice dans son annonce que Mum va naitre dans les mois et se développer dans les années à venir . Cette technologie n’est qu’un début de l’exploration de MUM et une étape nouvelle et importante où Google pourra dans un futur proche comprendre toutes les différentes façons dont les gens communiquent et interprètent naturellement les informations. Ci dssous lors du séminaire search I/O de cette année.